TPU vs GPU、なぜGoogleは長期的にAI競争に勝てる立場にあるのか?

一般的に機械学習の演算処理には並列計算が得意なGPUが使われます。しかし、Geminiなどを開発するGoogleは、より機械学習に最適なTPUを自社で開発しています。GoogleのTPUとGPUは何が違うのか、そしてGoogleがTPUを使い続ける戦略とはどういうものなのかについて、AIスタートアップの元CEOであるリハード・ジャーク氏が解説しています。

The chip made for the AI inference era – the Google TPU

https://www.uncoveralpha.com/p/the-chip-made-for-the-ai-inference Googleが独自のチップ開発に乗り出したきっかけは、技術的なブレイクスルーではなく、将来の計算資源に対する危機感でした。Googleは2013年頃に、もしすべてのAndroidユーザーが音声検索機能を1日にわずか3分間使用したら、その計算処理をさばくために現在の2倍のデータセンター容量が必要になるという試算を出しました。当時Googleが使用していた一般的なCPUやGPUは、ディープラーニングで必要となる膨大な行列計算に対して効率が悪く、既存のハードウェアで規模を拡大することは経済的にも物流的にも困難でした。そこでGoogleは、「TensorFlow」というニューラルネットワークを動かすことだけに特化したASIC(特定用途向け集積回路)を自社で開発することを決断しました。 このニューラルネットワーク特化ASICであるTPUの開発は急速に進み、設計開始からわずか15ヶ月後の2015年にはデータセンターへの配備が始まり、GoogleマップやGoogleフォト、翻訳機能などを裏側で支えるようになりました。

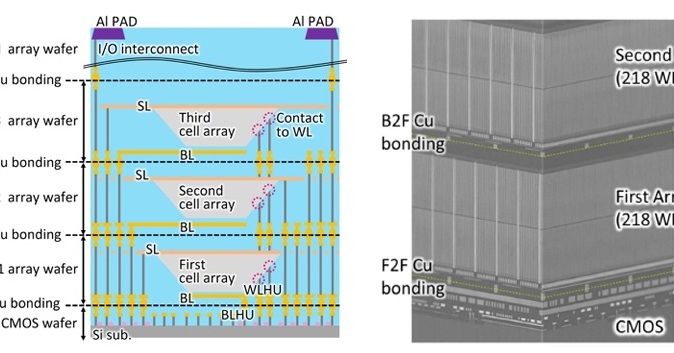

GPUとTPUの最大の違いは、汎用性を重視するか、特定の領域に特化しているかという点にあります。GPUはグラフィックス処理のために設計されており、並行処理が得意ですが、ゲームのテクスチャ処理から科学シミュレーションまで幅広く対応するために、キャッシュ管理や分岐予測といった複雑な機能を搭載しています。 一方、TPUはそうした不要な機能を取り除き、「シストリックアレイ」と呼ばれる独自の構造を採用しています。一般的なCPUやGPUでは計算のたびにメモリと演算ユニットの間でデータをやり取りする必要があり、これが処理速度のボトルネックとなりますが、TPUのシストリックアレイでは、心臓が血液を送り出すようにデータがチップ内を一方向に流れます。一度読み込んだデータ(重み)に対して、メモリへの書き戻しを行わずに次々と演算を行うため、メモリへのアクセス回数を劇的に減らし、演算そのものに処理能力を集中させることができます。

「Ironwood」というコードネームで呼ばれるTPUv7に関する情報は記事作成時点だと限られていますが、前世代と比べて大幅な性能向上が図られていることが明らかになっています。Googleによれば、TPUv7はBF16演算性能が4,614TFLOPSに達し、メモリ容量は192GB、帯域幅は毎秒7370GBで、旧世代のTPUv5pと比較して圧倒的なスペックを誇ります。

特定の用途においては、TPUはNVIDIA製のGPUと比較してコストパフォーマンスや電力効率で優れているといわれています。ジャーク氏によれば、Googleの元従業員は「適切なアプリケーションであればGPUと比較して費用対効果が最大1.4倍向上する」と述べており、エネルギー消費や発熱も抑えられるとのこと。また、Googleは新しい世代のTPUが登場すると旧世代の利用料を安くするため、最先端の速度を求めないユーザーにとってはコストを抑えられるという利点もあります。 TPUが広く一般企業に普及するための最大の障壁は、ソフトウェアのエコシステムにあります。多くのAIエンジニアは大学でNVIDIAの「CUDA」というプラットフォームを学んでおり、業界標準として定着していますが、TPUは主にJAXやTensorFlowといった異なる言語やライブラリを使用します。

また、多くの企業は複数のクラウドサービスを利用しており、特定のクラウドに依存することを避ける傾向があります。NVIDIAのGPUはAWSやAzure、Google Cloudのすべてで利用可能ですが、TPUはGoogle Cloudでしか利用できません。もしTPUに完全に依存してしまった場合、将来的にGoogleが値上げをした際に他社へ移行するためのコストや手間が膨大になる可能性が懸念点となります。 AI時代において、クラウド事業の利益率はNVIDIA製チップの高額なコストにより圧迫されつつありますが、自社製チップを持つことはその解決策となります。自社でASICを開発・運用することで、NVIDIAに支払う高い利益率分を節約し、かつての高い利益率を取り戻すことが可能になります。

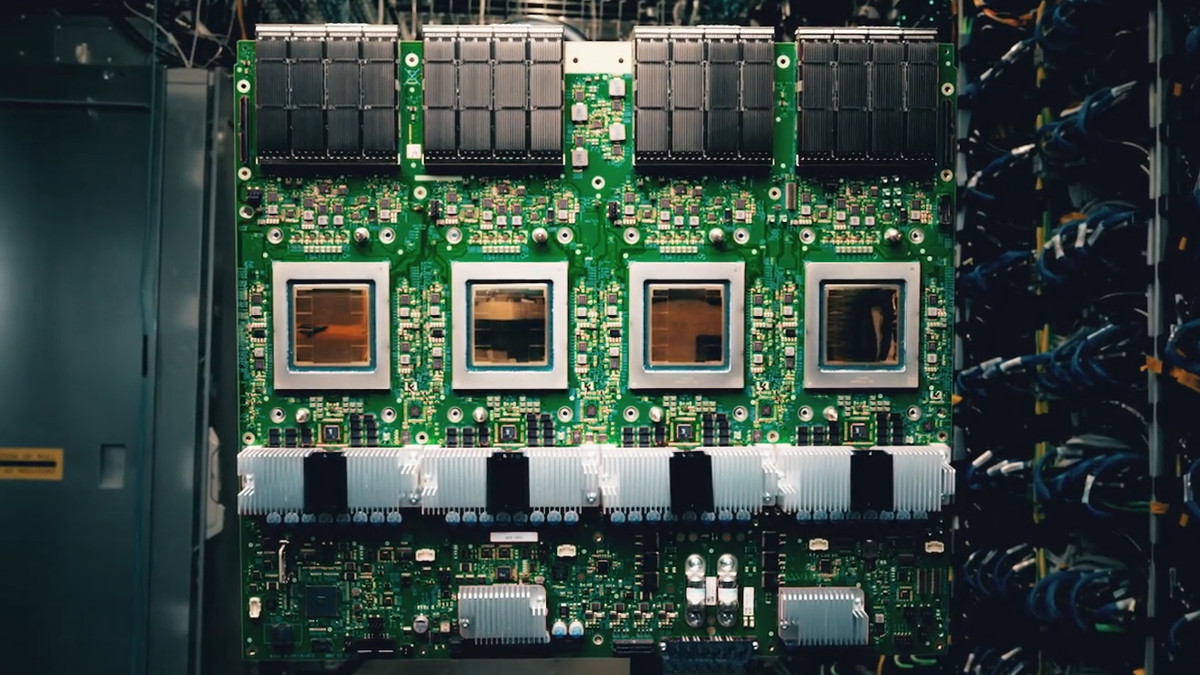

Googleはこの分野で最も成熟しており、チップの設計からソフトウェアの最適化までを自社でコントロールしています。現在、Googleの最新モデルであるGemini 3はTPUを用いてトレーニングされており、社内のAI推論ワークロードのほぼ全てでTPUが活用されています。外部顧客には馴染みのあるNVIDIA製GPUを提供しつつ、自社のサービス基盤にはコスト効率の良いTPUを全面採用するという戦略は、今後10年間のGoogleのクラウドビジネスにおいて最大の競争優位性になると、ジャーク氏は予想しました。 なお、NVIDIAは「Googleの成功に喜んでいます」というメッセージに加えて、「GoogleもNVIDIAのGPUを開発に使っており、汎用性ではGPUの方がTPUよりも優れています」と、NVIDIAの優位性をアピールしています。

We’re delighted by Google’s success — they’ve made great advances in AI and we continue to supply to Google.NVIDIA is a generation ahead of the industry — it’s the only platform that runs every AI model and does it everywhere computing is done.

NVIDIA offers greater…

— NVIDIA Newsroom (@nvidianewsroom) November 25, 2025

・関連記事 Geminiの開発にも使われているGoogleの第7世代AIチップ「Ironwood」が一般提供開始へ - GIGAZINE

GoogleとAnthropicがクラウドパートナーシップを正式発表、100万台以上のTPUの利用拡大でコンピューティング能力増大 - GIGAZINE

OpenAIがChatGPTなどの推論処理にGoogleのTPUを使用開始したとの報道、NVIDIA以外のAI処理チップを使うのは初 - GIGAZINE